| NPO曾被认为是CPO时代来临前的过渡性技术

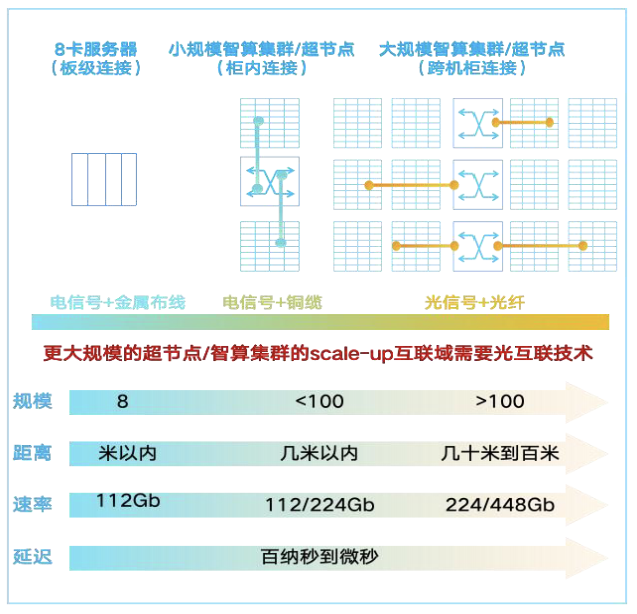

大模型的快速发展对智算集群的互联性能提出了更高要求,更大规模、更高带宽密度和极低时延成为主要需求。在规模方面,当前Scale-Up单层规模以32卡或64卡为主,需要进一步提升至256卡甚至千卡,高速传输的距离从板级、柜内扩展到柜间;在带宽密度方面,当前国内单通道带宽以200Gbps为主,需要进一步向800Gbps甚至1.6Tbps迈进,带宽密度要求提升至百Gbps/mm²到TGbps/mm²;在时延方面,当前卡间数据传输时延为微秒级,需要进一步缩短至百纳秒甚至十纳秒级。在此背景下,可插拔光模块的互连延迟和带宽瓶颈已无法满足需求,芯片级光互联技术落地应用有望加速。

▲来源:面向大规模智算集群场景光互连技术白皮书(2025年)

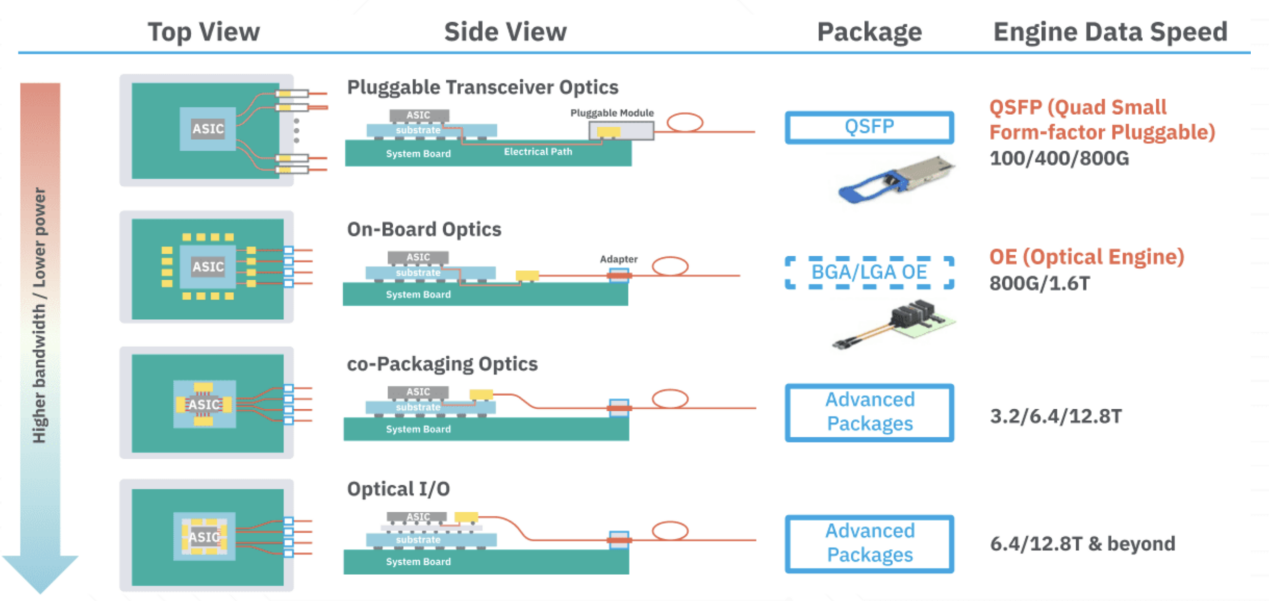

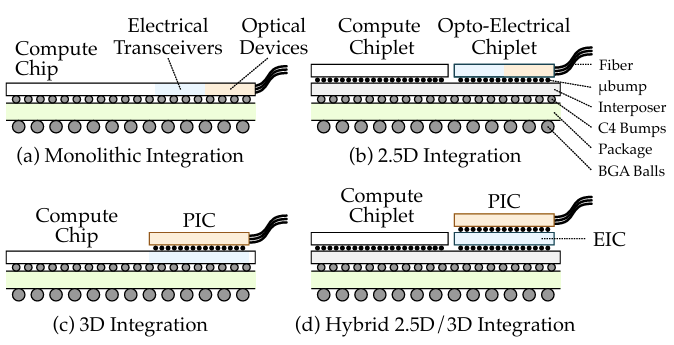

NPO是芯片级光互联技术的关键方案之一,并且被认为是CPO时代来临前的过渡性技术。根据应用场景、光引擎与xPU芯片的距离及封装集成度,可将光互联技术分为近封装光学(NPO,Near Packaged Optics)、共封装光学(CPO,Co-packaged Optics)及光学IO(OIO,Optical Input/Output)三类。其中,NPO被认为是过渡技术,该技术可将OE与封好的芯片通过高速基板封装,将电信号传输距离缩短至厘米级;CPO被认为是主流技术,该技术可将OE与未封好的电芯片实现芯片基板封装,将电信号的传输距离缩短至毫米级;OIO被认为是终极技术,该技术可将OE与计算芯片实现芯粒级封装,彻底摒弃传统的电IO。

▲来源:日月光

| CPO是中长期互联趋势,但多因素叠加致使其发展进度可能慢于预期

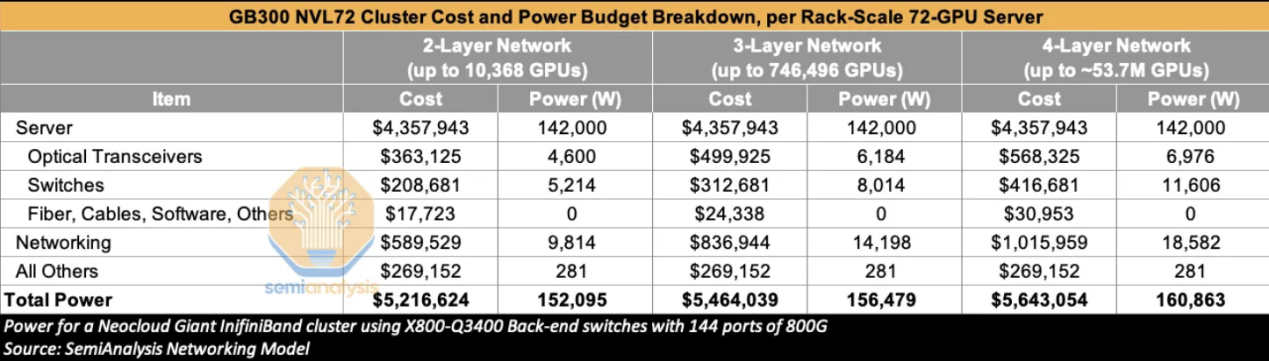

CPO在光模块成本及网络总功耗降低层面具有显著优势。网络成本是集群总成本中仅次于AI服务器的第二大成本,根据SemiAnalysis测算,在采用三层InfiniBand网络的GB300 NVL72集群中网络成本占比为15%,四层网络中网络成本占比为18%。而光模块是网络成本的重要组成部分,在使用英伟达LinkX收发器的三层网络中,光模块占网络成本的60%,占网络总功耗的45%。通常情况下,AI集群中GPU数量越多意味着网络需要升级到更高层次,这也意味着更高的成本和更大的功耗。而CPO不仅可以在保持网络层数不变的情况下降低功耗和成本,还能通过增加在给定层数的网络中可连接的GPU数量来降低总的功耗和成本需求。但总拥有成本(TCO)提高、制造难度大、散热要求高、可维护性差等因素叠加仍导致CPO发展进度可能慢于预期。

▲来源:SemiAnalysis

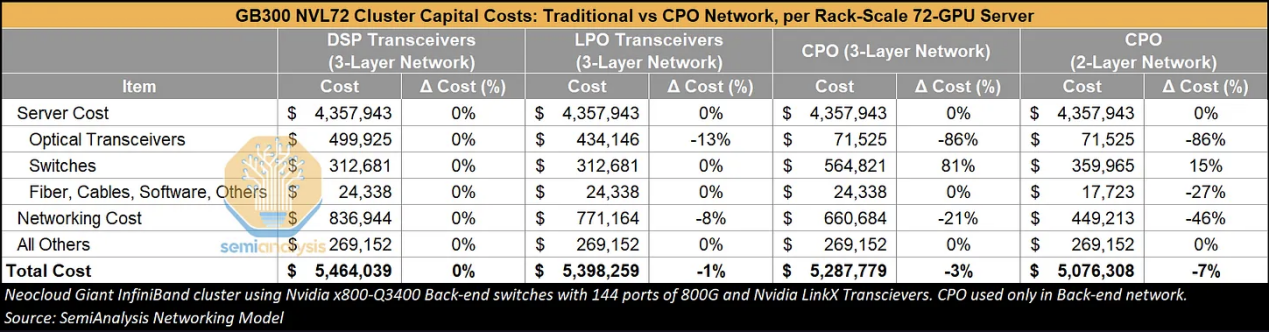

总拥有成本(TCO)方面,在考虑交换机供应商利润率的情况下,从光模块转向CPO的成本节省可能并不显著。根据SemiAnalysis测算,在三层网络中从光模块转向CPO时,CPO组件的额外利润率使交换机成本增加81%,这抵消了86%的光模块采购成本节省,尽管CPO的网络总成本仍比DSP光模块低21%,但服务器机架在集群TCO中占主导地位,因此集群总成本仅降低3%。

▲来源:SemiAnalysis

制造方面,CPO封装技术集成了光芯片、光引擎与交换机ASIC,这要求极高的工艺精度和制造能力。TSV(硅通孔)、TGV(三维玻璃通孔)等先进封装技术的应用,使得封装过程变得异常复杂。随着数据传输速率的不断提升,信号完整性问题愈发凸显,如何在封装内确保高速信号的稳定传输也是CPO技术面临的重要挑战。

▲来源:Scaling Co-Packaged Optical Interconnects Using Hybrid 2.5D/3D Integration

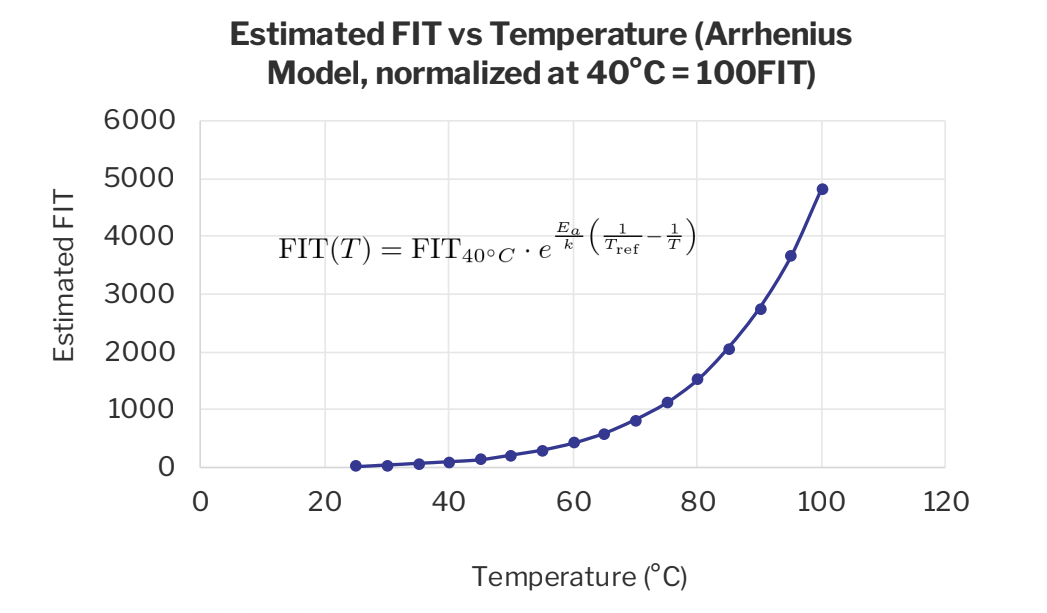

散热方面,CPO技术将高功率ASIC和光引擎封装在同一空间内,导致系统中心的热密度显著增加。PIC中的一些光学器件对温度很敏感,尤其是功耗较大的片上近距离集成激光器等有源器件,会因温度变化产生显著的性能漂移。基于Arrhenius模型的测算显示:当温度由40℃升至100℃时,激光器FIT值将飙升至5000,即激光器的寿命急剧缩短。因而散热设计也成为CPO技术突破的另一项重要挑战。

▲来源:2025 OCP APAC Summit

维护方面,CPO带来了故障影响范围大、维修成本高、操作门槛高、备件兼容难等连锁问题。CPO将光引擎(含硅光芯片、激光器、调制器、探测器等)与ASIC芯片共封装,任一光电组件故障均需更换整个封装模组、线卡甚至主板。同时,由于CPO高度集成化的架构设计,现场维修难以实施,运维需依赖原厂技术支持,增加了维护周期和成本。

| NPO可兼顾多方诉求,有望成为当前阶段的主导技术

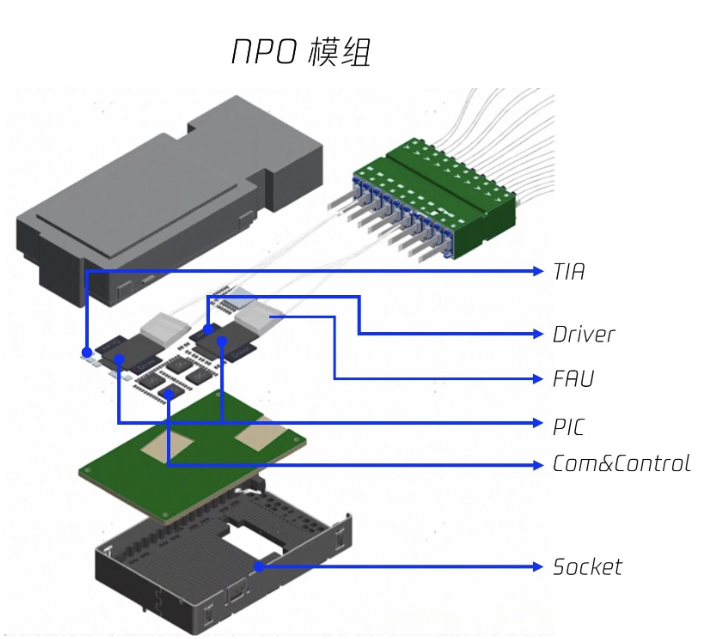

对于数据中心运营商而言,NPO技术可实现故障率减小、可维护性提升、运维成本下降。NPO将光引擎做成独立可热插拔模块,通过Socket插槽同板部署,兼具传统光模块灵活插拔和CPO缩短电信号传输距离的优势。NPO的光引擎与ASIC芯片物理分离、独立热设计,避免了CPO模式下芯片高温直接冲击光器件带来的热耦合问题,降低了光引擎故障率。即便故障发生,现场人员也可及时更换目标光引擎,而无需将整个封装模组、线卡甚至主板返回原厂维修,极大地提升了运维效率、降低了运维成本。

▲来源:腾讯

对于交换机供应链的厂商而言,NPO技术可兼容现有生态、缩短研发周期、提高量产良率、降低供应链风险。NPO可复用现有可插拔光模块的供应链、封装工艺和测试标准,可兼容现有交换机架构设计,大幅缩短研发周期,显著降低产业化难度。同时光电组件独立制造、测试后再与ASIC芯片近封装,可避免单一组件缺陷影响封装模组整体性能,从而实现量产良率稳步提升。除此以外,NPO实现光引擎与芯片解耦,支持多厂商光引擎兼容,降低对单一芯片厂商的依赖,可打造更为开放的产业生态、降低供应链风险。

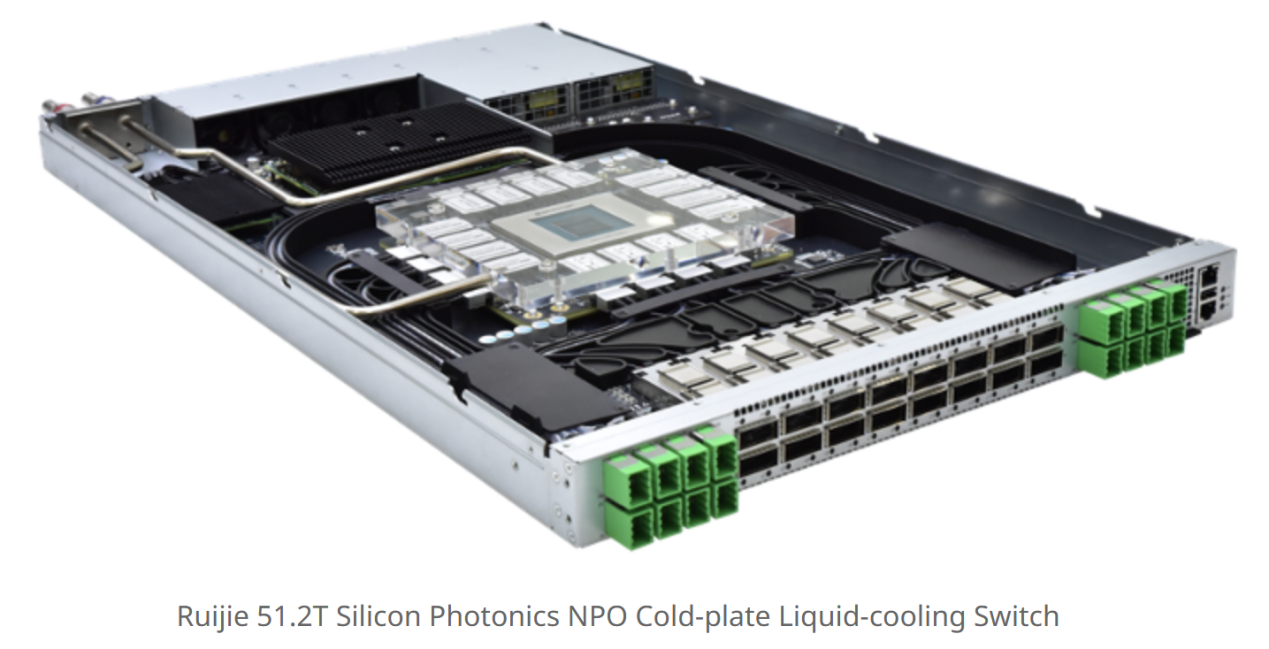

▲来源:锐捷网络

作为过渡技术的NPO具备平衡性能、成本、可维护性的优势,其生命周期有望延长并在当前阶段占据主导地位。核心源于:一方面,当前CPO仍面临良率、成本、运维、生态等多方面的挑战,尚未达到可大规模部署的状态,从而给NPO留下了更长的窗口期;另一方面,AI算力场景需求分化为NPO应用创造了机会,表现为超大规模智算中心追求CPO极致性能与能效的同时,边缘计算、中型AI集群等更偏好NPO的维护便捷、成本可控;除此以外,依托可插拔光模块成熟的供应链和生态,NPO产品大规模应用有望加速落地。